Экспериментальная психология

2021. Том 14. № 2. С. 101–112

doi:10.17759/exppsy.2021140207

ISSN: 2072-7593 / 2311-7036 (online)

Динамика ключевых точек лица как индикатор достоверности сообщаемой информации

Аннотация

Общая информация

Ключевые слова: видеоизображения коммуниканта, предикторы достоверности сообщаемой информации, ключевые точки лица, динамические структуры, оценка истинности информации

Рубрика издания: Наука о лице

Тип материала: научная статья

DOI: https://doi.org/10.17759/exppsy.2021140207

Финансирование. Работа выполнена при поддержке Российского научного фонда (РНФ) проект № 18-18-00350-П.

Для цитаты: Барабанщиков В.А., Жегалло А.В. Динамика ключевых точек лица как индикатор достоверности сообщаемой информации // Экспериментальная психология. 2021. Том 14. № 2. С. 101–112. DOI: 10.17759/exppsy.2021140207

Полный текст

Введение

При анализе оценок достоверности/недостоверности информации, сообщаемой коммуникантом в ходе непосредственного общения, в качестве маркеров, на которые ориентируется наблюдатель-партнер по общению, используются общие и локальные изменения мимики лица, направленности взора, положение головы, разнообразные жесты, движения рук и другие акты невербального поведения [Барабанщиков, 2018а]. Это требует от исследователя предварительной спецификации выделяемых актов и их пошаговой разметки. Выполнение подобных процедур вручную, путем пошагового кодирования и декодирования динамических признаков, представляется весьма трудоемким, а объективность экспериментальных данных, полученных таким путем, нуждается в дополнительном обосновании. Более эффективно эта задача может быть решена с помощью инструментов автоматизированной разметки динамки лица, которые стали появляться в последние годы. В данной работе рассматриваются перспективы использования технологий автоматической разметки видеоизображений лица человека при выполнении оценок достоверности/недостоверности сообщаемой им информации.

Программное обеспечение OpenFace [Baltrušaitis, 2018] выполняет автоматическую разметку положения лица натурщика на фото-и видеоизображении. Определяются координаты 68 ключевых опорных точек лица (в 2D и 3D пространстве); координаты 55 точек области глаз (также в 2D и 3D); направление взора; ориентация головы; выраженность 17 Action Units (AU1, AU2, AU4, AU5, AU6, AU7, AU9, AU10, AU14, AU15, AU17, AU20, AU23, AU25, AU26, AU45); подгоночные параметры Point Distribution Model, используемой для локализации положения ключевых точек лица. Подгоночные параметры представляют собой нагрузки для 34 главных компонент, представляющих собой характерные изменения структуры лица [Baltrušaitis]. Структура изменений лица предварительно была определена разработчиками программы на материале обучающей выборки.

Как видно из приведенного описания, разметка содержит группы данных, относятся к разным уровням описания выражения лица. Совместное использование нескольких групп показателей затрудняет дальнейшую содержательную интерпретацию результатов. В настоящей работе в качестве исходных данных была использована 3D разметка 68 ключевых точек лица. Работа носит методический характер, направлена на отработку приемов анализа и последующей визуализации результатов, а также, оценку перспективности использования разметки OpenFace как исходных данных о выражении лица натурщика.

Работа опирается на экспериментальный материал, полученный в ранее проведенном исследовании. Особенности окуломоторной активности участников эксперимента описаны в [Барабанщиков, 2018], линейная регрессионная модель, основанная на экспертной разметке данных, — в [Барабанщиков, 2018а].

Методы исследования

Процедура. В качестве стимульного материала использовались фрагменты видеозаписей искусственных и естественной коммуникативных ситуаций. В искусственно сконструированных ситуациях испытуемый должен был сообщать экспериментатору либо заведомо достоверную, либо заведомо ложную информацию. Естественная коммуникативная ситуация представляла собой фрагмент структурированной автобиографической беседы, основанной на выявлении факторов риска и вредных привычек [Барабанщиков, 2015].

В качестве стимульного материала было использовано 15 видеофрагментов (5 — ситуация «правда», 5 — ситуация «ложь», 5 — «интервью»). Съемка натурщика проводилась с помощью трех HD-видеокамер, расположенных справа, слева и перед лицом говорящего. Продолжительность каждого фрагмента составляла 60 с, частота 25 кадров/с, продолжительность одного кадра — 40 мс. Задача испытуемого состояла в том, чтобы во время просмотра видео определить по выражению лица натурщика те фрагменты беседы, когда последний выглядел искренним и вызывал доверие у наблюдателя — говорил правду (ответ — на клавиатуре ПК «стрелка вправо», «правда») или не вызываел доверие, лгал (ответ — «стрелка влево», «ложь»).

Испытуемые. В исследовании приняли участие 12 мужчин и 23 женщины в возрасте от 18 до 49 лет (средний возраст — 24,7 лет) с нормальным или скорректированным до нормального зрением. У всех испытуемых отсутствовал опыт оценки достоверности сообщаемой информации по невербальным признакам.

Обработка и анализ данных

Использованные в эксперименте видеофрагменты были подвергнуты автоматической разметке мимики лица с помощью ПО OpenFace 2.0. Результат разметки — трехмерные координаты 68 ключевых точек контура лица, глаз, рта и носа. Полученные данные (204 показателя) и информация о числе оценок «верю»/«не верю» агрегировались путем усреднения на временных интервалах продолжительностью 1000 мс (25 последовательных видеокадров). Линейный регрессионный анализ выполнялся в среде статистической обработки R [R Core Team, 2020]; использовалась функция lm (пакет stats). Первоначальный разведочный поиск выполнялся путем построения моделей, соответствующих комплексам признаков на текущем и предшествующих временных интервалах. Отбор наилучших моделей выполнялся по максимуму величины скорректированного коэффициента детерминации R2adj. Для дальнейшего детального анализа были выбраны модели, соответствующие координатам ключевых точек на временном интервале, предшествующем оценкам наблюдателей на 3 с.

Набор данных для дальнейшего детального анализа включал 750 интервалов данных (по 50 последовательных интервалов для каждого 60-секундного видеофрагмента, начальные интервалы были исключены как не релевантные). После построения моделей было проведено пошаговое исключение незначимых признаков, основанное на информационном критерии Акаике (AIC) (пакет stats, функция step). На очередном шаге из модели исключался признак, обеспечивающий максимальное уменьшение значения критерия. Остановка процедуры выполнялась, когда исключение любого из оставшихся признаков не уменьшало значение критерия [Hastie, 1992].

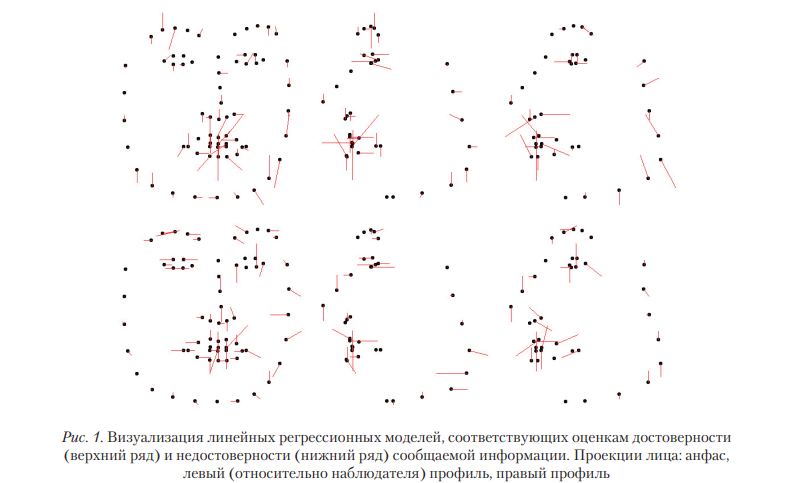

Итоговая регрессионная модель для оценок «правда» имела значение R2adj = 0,31, для оценок «ложь» — R2adj = 0,27. Непосредственная интерпретация полученных моделей затруднена тем, что даже после исключения незначимых признаков модели остаются достаточно объемными (99 признаков для оценок «правда», 100 признаков для оценок «ложь»). Для облегчения интерпретации мы применили следующий прием. Поскольку обсуждаемые признаки представляют собой координаты ключевых точек лица оцениваемого натурщика, соответствующие весовые коэффициенты модели следует рассматривать как направления и величины смещения соответствующих ключевых точек, соответствующие оценкам «правда» и «ложь». Координаты опорного лица вычислялись как средние координаты по исходному набору данных. Весовые коэффициенты визуализировались как вектора, выходящие из ключевых точек. Конечная координата каждого вектора определялась значениями соответствующих весовых коэффициентов. Полученные результаты представлены на рис. 1.

Для изображения, оцениваемого как достоверное, характерна вертикальная динамика левой (относительно наблюдателя) брови и смещение вниз нижней части рта. Изображение, оцениваемое как недостоверное, характеризуется горизонтальными смещениями в области бровей, левого глаза, частично рта. Также наблюдаются разнонаправленные горизонтальные смещения в средней правой части контура лица.

Из приведенных иллюстраций можно видеть, что динамика соседних ключевых точек зачастую носит разнонаправленный, противоречащий друг другу характер. Интерпретируя этот результат, мы делаем заключение, что построенные нами линейные регрессионные модели фактически отражают не единый комплекс признаков, связанный с оценками достоверности, либо недостоверности сообщаемой информации, а суперпозицию нескольких различных характерных изменений структуры лица, связанных с данными оценками.

В таком случае выделение собственно отдельных наиболее характерных признаков, на которые ориентируются наблюдатели может быть осуществлено путем решения задачи,аналогичной выполненной разработчиками OpenFace. Как уже упоминалось, в основе алгоритма детекции опорных точек лежит Point Distribution Model, опирающаяся на характерные изменения структуры лица. Дистрибутив программы содержит пример исходного кода, выполняющий выделение главных компонент модели на обучающей выборке.

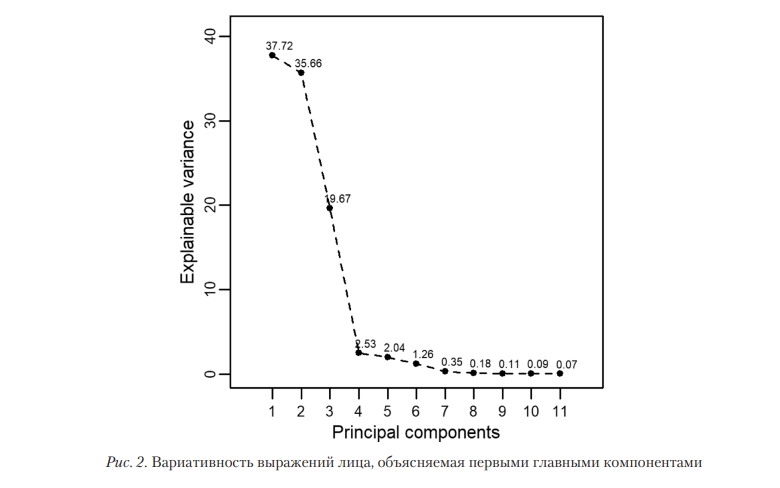

Для решения данной задачи была использована покадровая разметка X-, Y-, Z-координат ключевых точек лица для использованных в эксперименте видеофрагментов. Каждый видеофрагмент продолжительностью 60 секунд при 25 кадрах/с соответствовал 1500 размеченным кадрам. Суммарный объем для 15 видеофрагментов составил 22500 размеченных кадров, 204 переменные для каждого кадра (X-, Y-, Z-координаты 68 ключевых точек). Для полученного набора данных был проведен анализ главных компонент (пакет stats, функция prcomp с параметром scale=TRUE). Результаты анализа показывают, что имеющаяся вариативность выражения лица натурщика хорошо объясняется первыми главными компонентами. Так, первые 11 компонент объясняют 99,7% вариативности координат ключевых точек (рис. 2).

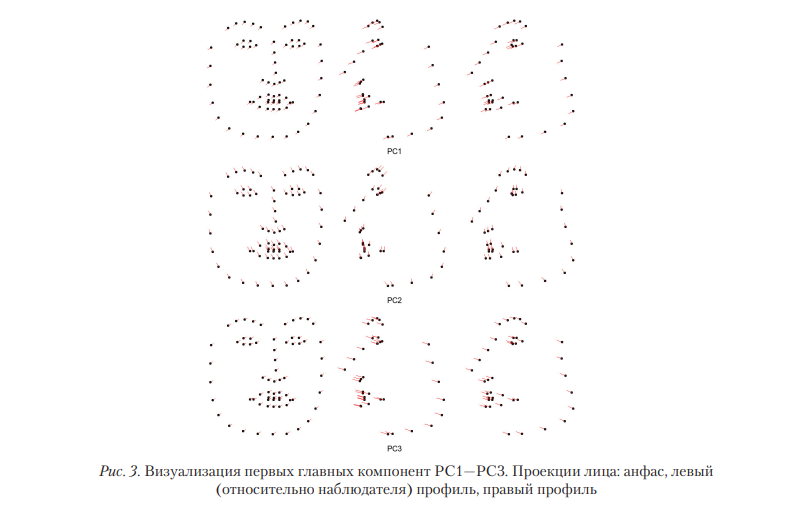

Рассмотрим подробнее содержательные характеристики первых главных компонент.

Компонента PC1 представляет собой смещение лица влево—вниз—вперед (относительно наблюдателя). Компонента PC2 — согласованное смещение влево—вверх; левая половина лица поворачивается назад, правая — вперед. Компонента PC3 — согласованное смещение вправо—вверх—вперед; см (рис. 3).

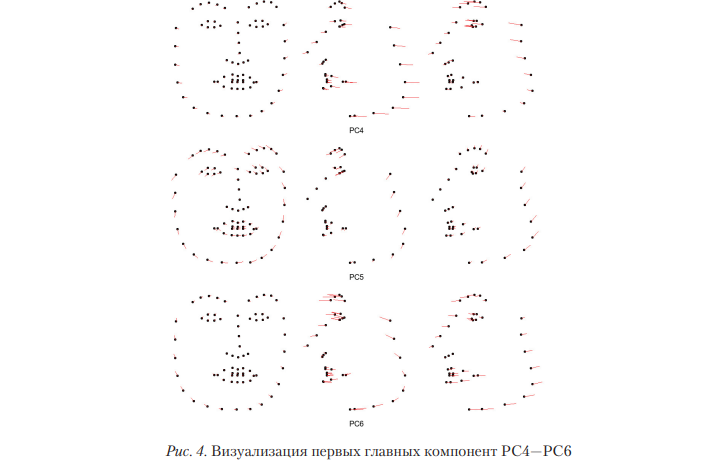

Компонента PC4 — смещение вправо, левая половина лица поворачивается назад, правая — вперед. Компонента PC5 — вращательное движение против часовой стрелки относительно кончика носа; левая половина лица поворачивается вперед, правая — назад. Компонента PC6 — наклон, верхняя часть смещается вперед, нижняя назад (рис. 4).

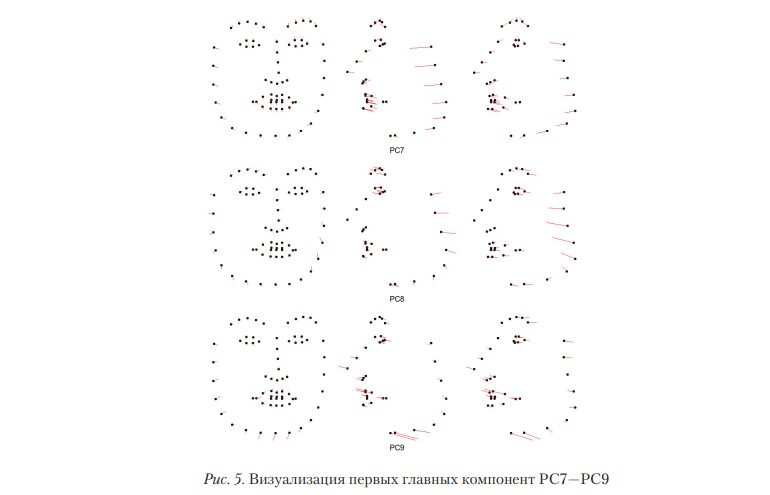

Компонента PC7 — «уменьшение глубины» лица; контур лица смещается вперед, контуры рта и носа — назад. Компонента PC8 — «увеличение глубины» в левой половине лица и «уменьшение глубины» в правой. Компонента PC9 — смещение рта вперед, подбородка — назад (рис. 5).

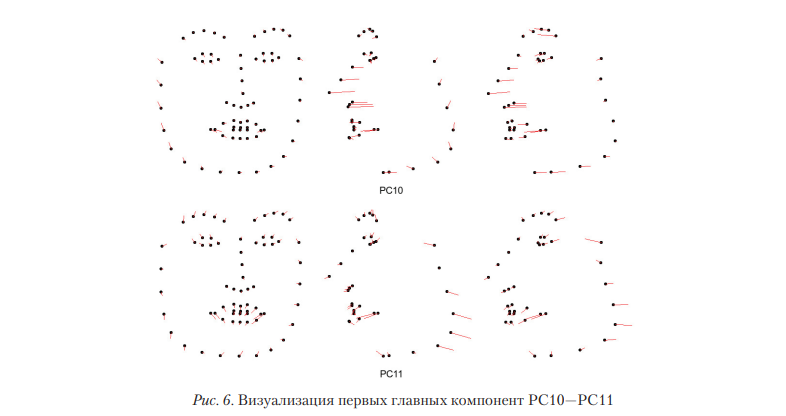

Компонента PC10 — нос смещается назад, уголки рта — вперед. Компонента PC11 — сжатие рта, уголки рта смещаются вперед, контур лица частично назад; глаза и брови приподнимаются (рис. 6).

В какой мере обсуждаемые главные компоненты связаны с оценками достоверности/ недостоверности сообщаемой информации? Для решения этой задачи была использована полученная в результате анализа матрица (204х22500 значений) нагрузок для каждого из кадров видеозаписи. Полученные данные были агрегированы для интервалов продолжительностью 12 кадров (480 мс). Для каждого интервала вычислялось суммарное количество оценок достоверности/недостоверности данных наблюдателями. С этими оценками сопоставлялись нагрузки главных компонент для временного интервала, в котором были даны оценки, и предшествующих временных интервалов. Глубина анализа составила 40 интервалов. Для каждой оценки и нагрузок главной компоненты вычислялся коэффициент корреляции Пирсона. Всего проверялось 204 (число главных компонент) х 40 (число временных интервалов) = 8160 комбинаций. Первоначальный отбор данных проводился на уровне значимости p < 10-4.

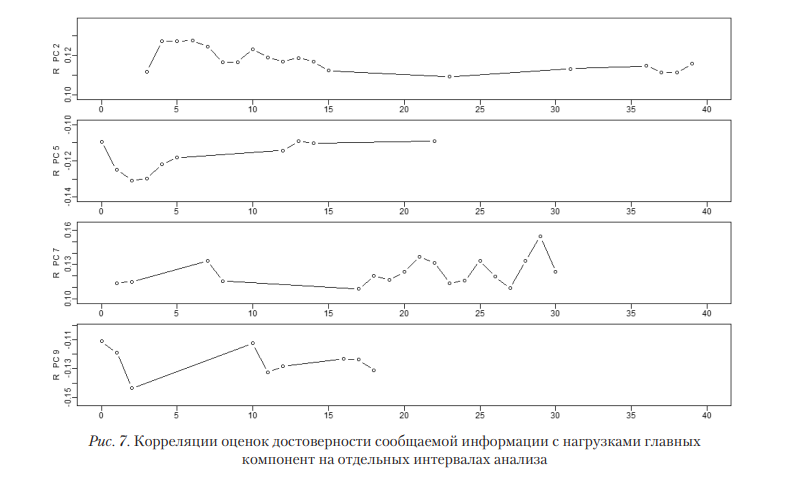

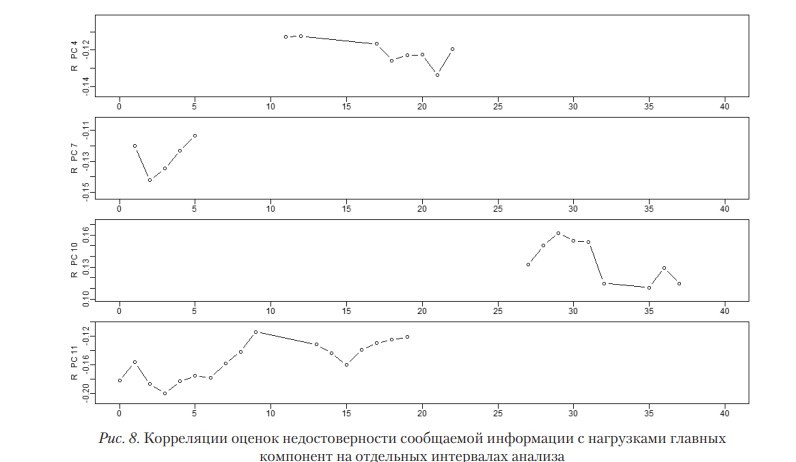

Для оценок достоверности сообщаемой информации по результатам первоначального отбора получена 71 значимая корреляция. При этом четырем наиболее частотным главным компонентам соответствуют в общей сложности 46 значимых корреляций. Для оценок недостоверности сообщаемой информации по результатам первоначального отбора получено 69 значимых корреляций. При этом четырем наиболее частотным главным компонентам соответствует в общей сложности 39 значимых корреляций

Результаты корреляционного анализа для четырех наиболее частотных главных компонент, обусловливающих оценку достоверности сообщаемой информации, представлены на рис. 7.

Представленные результаты показывают, что отдельные главные компоненты вносят свой вклад в оценки достоверности на разных временных интервалах. Компонента PC2 работает на временном интервале от -1.5 до -7 с и на интервале от -17 до -19 с. Компонента PC7 — на интервале от -7 до -14 с. Компонента PC9 — на интервале до -8 с. Компонента PC5 на интервале до -2 с снижает число оценок достоверности.

Результаты корреляционного анализа для четырех наиболее частотных главных компонент, обусловливающих оценку недостоверности сообщаемой информации, представлены на рис. 8.

Компонента PC4 обусловливает уменьшение оценок недостоверности в интервале от -7 до -11 с. Компонента PC7 обусловливает уменьшение оценок недостоверности в интервале от -0,5 до -2 с. Компонента PC10 обусловливает увеличение оценок недостоверности в интервале от -12 до -17 с. Компонента PC11 обусловливает уменьшение оценок недостоверности в интервале до -8 с.

Обсуждение результатов

Принимая максимальный объем анализа в 11 главных компонент и временной диапазон анализа в 40 интервалов, мы получаем общий объем анализа в 440 корреляций. В таком случае первоначальный уровень значимости p < 10-4 после консервативной коррекции на множественность сравнений соответствует p < 0,05. Таким образом, можно утверждать, что выявленные закономерности действительно являются статистически значимыми. За пределами возможностей анализа остается вклад низкочастотных главных компонент, характеризующихся корреляциями на малом числе временных интервалов (от 1 до 4 корреляций на компоненту). Действительно, редкие мимические проявления потенциально могут быть маркерами достоверности/недостоверности сообщаемой информации, однако получение статистически достоверных результатов в таком случае требует значительного увеличения объема анализируемого видеоряда.

Уточнение особенностей вклада отдельных главных компонент может быть проведено путем визуализации не сглаженной временной динамики анализируемой компоненты с нанесением временных отметок, соответствующих даваемым наблюдателями оценкам. Дополнительным фактором, опосредующим вклад динамики мимики лица, может быть направленность взора наблюдателя в момент появления потенциально важных изменений динамики лица.

Результаты корреляционного анализа показывают, что для отдельных динамических структур характерны различные сенситивные временные диапазоны. Различные изменения динамической структуры лица могут сказываться на даваемых наблюдателями оценках как относительно быстро, так и со значительным запаздыванием. Использовавшаяся нами глубина анализа в 20 с не в полной мере покрывает фактический диапазон связей между изменениями динамической структуры лица и даваемыми наблюдателями оценками. При планировании будущих экспериментов вместо большого числа коротких видеофрагментов следует использовать меньшее число более продолжительных видеофрагментов, что даст возможность увеличить глубину анализа без радикального увеличения общей продолжительности эксперимента.

Дальнейшее применение множественной линейной регрессии не представляется перспективным в силу высоких корреляций между нагрузками анализируемых главных компонент на соседних временных интервалах. В результате линейная регрессия может давать для соседних временных интервалов противоположные знаки коэффициентов регрессии для одной и той же главной компоненты, что противоречит данным корреляционного анализа.

Анализируемая трехмерная разметка продуцируется программой OpenFace на основе анализа двумерного видеоряда. При этом мы не анализировали алгоритм перехода к трехмерным данным. Отдельные данные по выделяемым главным компонентам (PC7, PC8) вызывают вопросы в части актуальной динамики лица, соответствующей изменениям его глубины. Решение данной задачи требует дополнительного анализа, предполагающего выделение участков видео с высокими значениями соответствующих компонент. В дальнейшем оптимальным способом получения разметки представляется переход к использованию оборудования, позволяющего аппаратно определять глубину изображения, например Intel RealSense D435.

Заключение

Полученные результаты демонстрируют принципиальную возможность использования разметки ключевых точек лица в качестве источника информации о его динамике. Далее выделенные характеристики динамики лица могут быть ассоциированы с изучаемыми особенностями восприятия выражения лица коммуниканта.

Выделяемые главные компоненты представляют собой комплексные согласованные динамические изменения структуры лица, отражающие характерные изменения положения головы и мимические проявления. Особенности анализа позволяют определить характерные динамические паттерны, покрывающие основной диапазон динамических изменений.

Очевидно, что предлагаемый метод не отменяет, а дополняет описанные ранее процедуры ручного кодирования/декодирования динамической информации о внешности коммуниканта. Автоматизированный анализ динамики ключевых точек лица не только оптимизирует процесс сбора эмпирических данных и их семантическое структурирование, но и расширяет спектр предикторов оценок истинности получаемых сообщений.

Литература

- Барабанщиков В.А., Жегалло А.В. Окуломоторная активность при восприятии динамических и статических выражений лица // Экспериментальная психология. 2018. Том 11. № 1. С. 5—34. DOI:10.17759/exppsy.2018110101

- Барабанщиков В.А., Жегалло А.В., Хозе Е.Г., Соломонова А.В. Невербальные предикторы оценок достоверности/недостоверности сообщаемой информации // Экспериментальная психология. 2018. Том 11. № 4. С. 94—106. DOI:10.17759/exppsy.2018110408

- Барабанщиков В.А., Носуленко В.Н., Самойленко Е.С., Хозе Е.Г. Полипозиционное наблюдение за поведением людей в процессе целенаправленной структурированной беседы // Психология и педагогика XXI века: теория, практика и перспективы / Н.Б. Карабущенко, Н.П. Сунгурова. М.: РУДН, 2015. С. 109—131.

- Baltrušaitis T. Automatic facial expression analysis // Submitted on March, 2014 for the Degree of Doctor of Philosophy. Fitzwilliam College. University of Cambridge.

- Baltrušaitis T., Zadeh A., Lim Y.C., Morency Y-P. OpenFace 2.0: Facial Behavior Analysis Toolkit // Proc. IEEE International Conference on Automatic Face and Gesture Recognition. 15—19 May 2018. Xi’an, China, 2018. (FG ’18). Piscataway, NJ: Institute of Electrical and Electronics Engineers (IEEE), 2018. P. 59—66. DOI: 10.1109/FG.2018.00019

- Hastie T.J., Pregibon D. Chapter 6. Generalized linear models // Statistical Models in S / eds Chambers J.M., Hastie T.J. London: Chapman & Hall, 1992. P. 195—248.

- R Core Team. R: A language and environment for statistical computing [Электронный ресурс] // R Foundation for Statistical Computing. Vienna, Austria, 2020. URL: https://www.R-project.org/ (дата обращения: 07.06.2021).

Информация об авторах

Метрики

Просмотров web

За все время: 679

В прошлом месяце: 21

В текущем месяце: 7

Скачиваний PDF

За все время: 476

В прошлом месяце: 10

В текущем месяце: 1

Всего

За все время: 1155

В прошлом месяце: 31

В текущем месяце: 8